BK

Белая Каска / RP9

SEO Ops Panel

Операционный мини-сайт по внедрению SEO-улучшений для `rp9.ru` (по аудитам, гайдам и текущей проверке).

План и задачи (единая вкладка)

План этапа 1 и рабочий чеклист объединены в одном разделе.

Операционный дашборд (день)

Отправлено

300

Мониторинг

75

Следующая отправка

Только дельта

Техриск

5XX ~ 0

Порядок

TOP20 → IMPORTANT100 → RECRAWL

SEO-метрики (компактно):

база

6.3/10 • цель 8.0-8.3/10 • отправлено/мониторинг 300 / 75 • задач 45 • текущая 6.5/10 (+3.9%) • прогресс до цели 13%.

План этапа 1: детальный порядок работ (раскрыть/свернуть)

Шаг 1: контроль

Шаг 2: проверка head-SEO (canonical, meta description, OG, Twitter, JSON-LD) на главной и типовых страницах.

Шаг 3: GSC + Яндекс.Вебмастер (sitemap/status/исключения), запуск переобхода приоритетных URL.

Шаг 4: контроль скорости home и стабильности (4XX/5XX, legacy 301/410).

Шаг 5: фиксация результата и отметка выполненных пунктов прямо в чеклисте ниже.

/sitemap.xml и /robots.txt (HTTP 200), проверка 3-5 URL из sitemap.Шаг 2: проверка head-SEO (canonical, meta description, OG, Twitter, JSON-LD) на главной и типовых страницах.

Шаг 3: GSC + Яндекс.Вебмастер (sitemap/status/исключения), запуск переобхода приоритетных URL.

Шаг 4: контроль скорости home и стабильности (4XX/5XX, legacy 301/410).

Шаг 5: фиксация результата и отметка выполненных пунктов прямо в чеклисте ниже.

Явный чеклист: отмечай задачи галочками по мере выполнения.

Срочно: переход Дзена на новые IP (проверить allowlist)

Что сделать: добавить новые IP Дзена в доверенные списки сайта, WAF и DDoS-защиты, чтобы не остановилась индексация.

IPv4: 217.174.191.100, 217.174.191.102, 217.174.191.103, 217.174.191.96, 90.156.236.16, 90.156.236.20, 90.156.236.22, 90.156.236.23, 95.163.34.64, 95.163.34.68, 95.163.34.70, 95.163.34.71.

IPv6: 2a00:b4c0:1c1:0:0:0:2296::, 2a00:b4c0:1c1:0:0:0:182::, 2a00:b4c0:1c1:0:0:0:183::, 2a00:b4c0:3c1:0:0:0:2dc::, 2a00:b4c0:3c1:0:0:0:383d::, 2a00:b4c0:3c1:0:0:0:383e::, 2a00:b4c0:8c1:0:0:0:9e::, 2a00:b4c0:8c1:0:0:0:abc::, 2a00:b4c0:8c1:0:0:0:abe::, 2a00:b4c0:1c1:0:0:0:9fd::, 2a00:b4c0:3c1:0:0:0:2034::, 2a00:b4c0:8c1:0:0:0:4eb::.

Контроль после внесения: 72 часа мониторить 403/429/5xx в логах и убедиться, что всплеска ошибок нет.

IPv4: 217.174.191.100, 217.174.191.102, 217.174.191.103, 217.174.191.96, 90.156.236.16, 90.156.236.20, 90.156.236.22, 90.156.236.23, 95.163.34.64, 95.163.34.68, 95.163.34.70, 95.163.34.71.

IPv6: 2a00:b4c0:1c1:0:0:0:2296::, 2a00:b4c0:1c1:0:0:0:182::, 2a00:b4c0:1c1:0:0:0:183::, 2a00:b4c0:3c1:0:0:0:2dc::, 2a00:b4c0:3c1:0:0:0:383d::, 2a00:b4c0:3c1:0:0:0:383e::, 2a00:b4c0:8c1:0:0:0:9e::, 2a00:b4c0:8c1:0:0:0:abc::, 2a00:b4c0:8c1:0:0:0:abe::, 2a00:b4c0:1c1:0:0:0:9fd::, 2a00:b4c0:3c1:0:0:0:2034::, 2a00:b4c0:8c1:0:0:0:4eb::.

Контроль после внесения: 72 часа мониторить 403/429/5xx в логах и убедиться, что всплеска ошибок нет.

Всего задач

0

Выполнено

0

В работе

0

Не выполнено

0

Готовность

0%

Справка и контроль

Минимум теории, максимум контроля.

Статус качества sitemap/robots

sitemap.xml: ~8.5/10 — практически готов к продакшену.robots.txt: ~9/10 — почти идеален для shared-хостинга.

Чтобы считать оба файла production-grade: закрываем финальный 15-минутный чек (10 автопроверок), особенно по canonical/indexable URL и HTTP-статусам.

Факты

| Проверка | Что зафиксировано | Какой вывод для бизнеса |

|---|---|---|

| Meta Description | На проверенных страницах отсутствует системно. | Теряем CTR из выдачи. |

| Canonical | Не везде внедрен/отсутствует. | Риск дублей и размывания релевантности. |

| Schema.org | Нет цельного слоя разметки сущностей. | Поиск/AI хуже понимают контент. |

| Open Graph / Twitter | Недостаточное покрытие. | Слабое превью и потери кликов из соцсетей. |

| robots/sitemap | База есть, но нужна настройка качества. | Можно ускорить индексацию и очистить мусорные URL. |

Показать roadmap / каналы / Q&A

Roadmap 7/14/30

- 7 дней: закрыть базу meta/canonical/schema/OG + контроль sitemap/robots.

- 14 дней: добить category/post/search, редиректы и качество индексации.

- 30 дней: закрепить результат по скорости, перелинковке и SEO-QA регламенту.

Каналы

- Яндекс/Google: индекс, ошибки, сниппеты, schema.

- AI: сущности и машиночитаемая структура.

- Соцсети/Дзен: OG/Twitter, стабильный обход и репаблишинг.

Q&A

- ТОП-1? Не обещаем позиции, отвечаем за процесс и KPI.

- Этап 1? Базовый SEO-фундамент.

- Как меряем эффект? До/после + вебмастера + CTR/индекс.

Инструкции в панели (shared)

Да, логика верная: на shared мы в основном меняем файлы через файловый менеджер панели

(или FTP/SFTP) и проверяем результат в браузере + GSC/Яндекс.

Быстрый путь: 1) Sitemap -> 2) robots.txt -> 3) отправка в GSC/ЯВ -> 4) фиксация в журнале.

Наглядно: было / стало

Sitemap — было (фрагмент):

<url>

<loc>https://rp9.ru/analitika</loc>

<lastmod>2025-07-31T14:33:52+00:00</lastmod>

<priority>1.0</priority>

</url>

<url>

<loc>https://rp9.ru/balkon</loc>

<lastmod>2015-03-24T07:18:24+00:00</lastmod>

<priority>1.0</priority>

</url>

Sitemap — стало (фрагмент):

<url>

<loc>https://rp9.ru/analitika</loc>

<lastmod>2025-07-31T14:33:52+00:00</lastmod>

<changefreq>weekly</changefreq>

<priority>0.7</priority>

</url>

<url>

<loc>https://rp9.ru/balkon</loc>

<lastmod>2015-03-24T07:18:24+00:00</lastmod>

<changefreq>yearly</changefreq>

<priority>0.2</priority>

</url>

robots.txt — было (факт с сайта):

User-agent: *

Disallow: /admin/

Disallow: /login/

Disallow: /register/

Host: https://rp9.ru/

Sitemap: https://rp9.ru/sitemap.xml

robots.txt — стало (safe shared):

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /login/

Disallow: /register/

Disallow: /api/

Disallow: /search

Disallow: /search/

Disallow: /*?*utm_*

Sitemap: https://rp9.ru/sitemap.xmlКритерии приоритета в sitemap (обоснование)

| Сигнал | Что видим в HTML/разделе | Решение для sitemap | Пример URL | Почему так |

|---|---|---|---|---|

| Ключевой хаб | Раздел верхнего уровня, свежие публикации, много внутренних ссылок | priority 0.9, changefreq daily |

/novosti, /nedvizhimost |

Максимальная ценность для обхода и перелинковки |

| Активная подрубрика | Публикации есть, но темп ниже хабов | priority 0.7-0.8, daily/weekly |

/analitika, /ipoteka |

Нужен регулярный краул, но ниже главных разделов |

| Стабильный evergreen | Контент полезный, обновляется эпизодически | priority 0.6, monthly |

/krovlya, /okna |

Поддерживаем индекс без лишней нагрузки |

| Старая/архивная рубрика | Очень старый lastmod, низкая деловая ценность |

priority 0.2-0.3, yearly |

/balkon, /gostinnaya |

Не конкурирует с актуальными страницами за crawl budget |

| Смешанный/технический поток | Широкая «сборная» рубрика без четкого интента | priority 0.2-0.4, weekly/monthly |

/raznoe, /bez-rubriki |

Снижаем переобход шумных страниц |

Правило качества:

priority — относительный вес URL внутри сайта (не «гарантия позиции»). Важно выдерживать иерархию:

хабы выше, архив и размытые рубрики ниже.

6 шагов

1) Sitemap

Где: корень сайта (

Что: заменить

Проверка:

Где: корень сайта (

public_html/www)Что: заменить

sitemap.xml из rp9-sitemap-ideal.xmlПроверка:

/sitemap.xml = 200, отправлен в GSC/ЯВ

2) robots.txt

Где: корень сайта

Что:

Проверка:

Где: корень сайта

Что:

robots.txt из rp9-robots-shared.txtПроверка:

/robots.txt = 200, важные разделы не закрыты

3) Head-теги

Где: шаблоны CMS/темы (head)

Что: canonical + meta + og/twitter + JSON-LD

Проверка: View Source + Rich Results Test

Где: шаблоны CMS/темы (head)

Что: canonical + meta + og/twitter + JSON-LD

Проверка: View Source + Rich Results Test

4) Контентная структура

Где: шаблоны + редактор контента

Что: 1 H1, логичные H2/H3, осмысленные alt

Проверка: вручную 10 приоритетных URL

Где: шаблоны + редактор контента

Что: 1 H1, логичные H2/H3, осмысленные alt

Проверка: вручную 10 приоритетных URL

5) Лог изменений

Где:

Что: дата, файл, URL проверки, статус, замечания

Проверка: запись есть после каждого релиза

Где:

rp9-shared-hosting-seo-improvements.mdЧто: дата, файл, URL проверки, статус, замечания

Проверка: запись есть после каждого релиза

6) Командный handoff

SEO: ведет план

Dev: заливает файлы + шаблоны

QA: фиксирует проверки и результат

SEO: ведет план

Dev: заливает файлы + шаблоны

QA: фиксирует проверки и результат

Показать готовые примеры вставки (sitemap / robots / head / h1-alt / журнал)

Sitemap (фрагмент)

<url>

<loc>https://rp9.ru/nedvizhimost</loc>

<lastmod>2026-04-13T17:50:33+00:00</lastmod>

<changefreq>daily</changefreq>

<priority>0.9</priority>

</url>

robots.txt (safe shared)

User-agent: *

Allow: /

Disallow: /admin/

Disallow: /login/

Disallow: /register/

Disallow: /api/

Disallow: /search

Disallow: /search/

Disallow: /*?*utm_*

Sitemap: https://rp9.ru/sitemap.xml

Canonical + Meta + OG/Twitter + JSON-LD

<link rel="canonical" href="https://rp9.ru/{{ slug }}" />

<meta name="description" content="Короткое описание до 160 символов." />

<meta property="og:title" content="{{ title }}" />

<meta name="twitter:card" content="summary_large_image" />

<script type="application/ld+json">{"@context":"https://schema.org","@type":"Article"}</script>

H1-H3 + alt и лог релиза

<h1>Новости недвижимости Москвы</h1>

<h2>Главные тренды 2026</h2>

<h3>Ипотека и спрос</h3>

<img src="/img/ipoteka.jpg" alt="График ставок по ипотеке в 2026 году" />

2026-04-26 | SEO-REL-07

Изменено: sitemap.xml, robots.txt

Проверка: /sitemap.xml (200), /robots.txt (200)

Статус: doneОперационная карта

| Пункт | Где менять | Что вставить/обновить | Как проверить | Частая ошибка |

|---|---|---|---|---|

| 1. Sitemap | Файловый менеджер хостинга, корень сайта | sitemap.xml из rp9-sitemap-ideal.xml |

/sitemap.xml = 200, URL из карты = 200, отправлен в GSC/ЯВ |

Оставляют старый sitemap или заливают не в корень |

| 2. robots.txt | Файловый менеджер хостинга, корень сайта | robots.txt из rp9-robots-shared.txt |

/robots.txt = 200, ключевые URL не заблокированы |

Случайно закрывают важные разделы сайта |

| 3. Canonical/Meta/OG/Schema | Шаблоны CMS/темы (head-блок) | canonical, description, og/twitter, JSON-LD | View Source + Rich Results Test | Теги есть в CMS, но их нет в финальном HTML |

| 4. H1-H3 + alt | Шаблоны + редактор контента | 1 H1, логичные H2/H3, осмысленный alt | Проверка 10 приоритетных URL вручную | Несколько H1 и alt-спам по ключам |

| 5. Фиксация изменений | rp9-shared-hosting-seo-improvements.md |

Дата, что меняли, ссылки проверки, статус | Есть запись по каждому релизу | Сделали правки, но не зафиксировали факт |

| 6. Командный контур | Этот mini-site + рабочие md/xml/txt | SEO/Dev/QA роли и handoff | У каждой задачи есть владелец | “Все думают, что делает кто-то другой” |

Релиз-правило: сначала выкатываем sitemap/robots, затем head-теги и schema, потом контентные правки. Не объединяем все изменения в один большой релиз.

План этапа 1: детальный протокол

Цель этапа 1: закрыть критичный тех-контур (индексация + head SEO + фиксация результата).

Шаг 1: контроль базы (уже внедренное)

- [ ] Проверить доступность

/sitemap.xmlи/robots.txt(оба должны отдавать200). - [ ] Убедиться, что robots содержит

Sitemap: https://rp9.ru/sitemap.xml. - [ ] Проверить 3-5 URL из sitemap: нет 4xx/5xx.

Шаг 2: head-SEO слой (критично)

- [ ] Проверить на главной и 1-2 типовых страницах:

canonical,meta description,og:*,twitter:card,JSON-LD. - [ ] Если любого тега нет в финальном HTML (

View Source) — дофиксить шаблон и повторно проверить. - [ ] Зафиксировать минимум 3 URL, где head-набор подтвержден полностью.

Шаг 3: вебмастера и переобход

- [ ] GSC: проверить sitemap/status и coverage по важным URL.

- [ ] Яндекс.Вебмастер: проверить sitemap/status и исключенные URL.

- [ ] Запустить переобход приоритетных страниц (главная + ключевые рубрики + свежие статьи).

Шаг 4: производительность и стабильность

- [ ] Проверить текущий ответ home (ориентир 1.0–2.0s).

- [ ] Проверить, что нет всплеска

5XXи массовых новых4XX. - [ ] Подтвердить, что legacy

/*.htmlобрабатываются по модели301/410.

Шаг 5: фиксация результата этапа 1

- [ ] Обновить отчет “что сделано / что в работе / что осталось”.

- [ ] Отметить галочками выполненные задачи в чеклисте панели.

- [ ] Зафиксировать план контроля на 7 и 14 день (индексация/ошибки/скорость).

Чек закрытия этапа 1 (15 минут, 10 проверок)

Если все 10 пунктов “ОК”, этап 1 можно считать закрытым и переходить к этапу 2.

| # | Проверка | Критерий “ОК” | Статус |

|---|---|---|---|

| 1 | /sitemap.xml доступен | HTTP 200 | [ ] |

| 2 | XML валидность sitemap | Нет синтаксических ошибок | [ ] |

| 3 | URL из sitemap живые | Нет 4xx/5xx | [ ] |

| 4 | Только indexable URL | Нет noindex в sitemap | [ ] |

| 5 | Только canonical URL | Нет дублей/параметрических URL | [ ] |

| 6 | lastmod релевантен | Соответствует фактическим обновлениям | [ ] |

| 7 | /robots.txt доступен | HTTP 200 | [ ] |

| 8 | Sitemap в robots актуален | Sitemap: https://rp9.ru/sitemap.xml | [ ] |

| 9 | Robots-тестер (GSC + ЯВ) | 5-10 ключевых URL не блокируются | [ ] |

| 10 | Пост-выкатный контроль | Нет всплеска исключений/ошибок индекса | [ ] |

Дополнительно (опционально)

- Release gate: мини-гейт перед каждым SEO-релизом.

- Rollback plan: готовый сценарий отката.

- Owner map: закрепить владельца за каждым блоком.

Подробный отчет по выполненным SEO и техническим работам

Дата отчета: 26.04.2026 • Формат: расширенный отчет для передачи заказчику/руководителю •

Цель: зафиксировать выполненные улучшения, текущий статус, эффект и дальнейшие действия.

Технический отчет для Tech Lead (полная версия)

Проект: rp9.ru (Django + Passenger + nginx)

Дата среза: 26.04.2026

Фокус: индексация, sitemap, производительность home, cleanup legacy URL

Приоритизация: P0 (критично), P1 (высокий), P2 (плановый)

Дата среза: 26.04.2026

Фокус: индексация, sitemap, производительность home, cleanup legacy URL

Приоритизация: P0 (критично), P1 (высокий), P2 (плановый)

1) Executive technical summary

- Индексационный контур переведен в модель

sitemap index -> section sitemaps. - Качество состава sitemap улучшено: фильтрация слабых рубрик, дедуп URL, архивный cutoff, динамические

priority/changefreq. - Home-рендер ускорен за счет снижения N+1 и кэширования.

- Legacy

/*.htmlURL добавлены в управляемый pipeline (301 -> canonicalлибо410). - Зафиксирован прирост по времени ответа home:

~6793ms -> ~1359ms.

2) Сделанные изменения (код/архитектура)

2.1 Sitemap / indexing pipeline

- Подключен

django.contrib.sitemaps. - Настроены роуты:

/sitemap.xml -> index,/sitemap-<section>.xml -> section. - Введено кеширование sitemap-роутов:

cache_page(30m). - Усилена логика

main/sitemaps.py: фильтрацияWEAK_CATEGORY_SLUGS, валидация slug, архивный cutoff, дедуп конечных путей, динамические приоритеты/частота.

2.2 URL policy / slug normalization

- В

main/models.pyдляNewsвнедрена нормализация slug. - Добавлены: очистка/нормализация, лимит длины, контроль хвостов

-9/-10/..., корректное разрешение коллизий.

2.3 Home performance & content shaping

- Оптимизирован

main/views.py::home: снижение N+1,only(...), исключение слабых рубрик, устранение пересечений контента. - Шаблонные правки: удаление дубля в

latest-news.html, нормализацияtitleкарточек, ограничениеdescriptionв листингах. - Включено кеширование home в

main/urls.py:cache_page(10m).

2.4 Legacy URL handling

- Добавлен маршрут

/<slug>.htmlи обработчик вviews.py. - Если найден

News(url=slug, active=1)->301на канонический путь; иначе ->410 Gone.

3) Подтвержденные результаты

- Home response time: улучшение порядка ~5x (

~6793ms -> ~1359ms). - Sitemap health:

sitemap.xml= 200, секционные карты доступны, robots указывает на актуальный sitemap. - Crawl stability: критичных

5XXне наблюдается; основной хвост — исторические4XX. - Metadata baseline: для home подтвержден набор

title/description/canonical/robots/OG/Twitter/JSON-LD.

4) RCA

- Исторические 404 связаны со старой URL-структурой

/*.htmlи внешними ссылками. - Высокий latency home (до правок): неоптимальные выборки, шаблонные дубли, тяжелый HTML.

- Низкий quality signal в sitemap (до правок): слабые категории, неоднородные slug, архивный шум.

5) Приоритизация следующего этапа

- P0 (сделано/контроль): dynamic sitemap, фильтрация URL, кеш sitemap/home, legacy handler 301/410; открытый пункт — контроль отсутствия перекрытия Django-роута статическим

/sitemap.xml. - P1: оптимизация

show_category/show_post/search_results, точечные redirect rules по top legacy hits, зачистка устаревшей внутренней линковки. - P2: weekly snapshot crawl budget, post-deploy smoke-check, расширенный structured data per template type.

6) Риски и mitigations

- Ложная интерпретация исторических 404 как текущей деградации -> анализ тренда 7/14/30 дней.

- Канонические несоответствия при массовых миграциях slug -> строгая проверка canonical + redirect map.

- Регресс времени ответа из-за тяжелых блоков category/post -> целевой P1-пакет оптимизации.

- Повторное перекрытие dynamic sitemap статическим файлом -> деплой-чек с явной проверкой.

7) Контрольные метрики (SLO/SLI)

- Home response (bot-facing):

~1.0–2.0s. 5XX: целевой уровень ~0.4XX: устойчивый нисходящий тренд по legacy-пулу.- Sitemap parsing:

OK, без ошибок обработки. - Индексация: без немотивированных просадок >20% на 2-недельном окне.

8) Операционно в Яндекс Вебмастере

- Подтвержден основной sitemap:

https://rp9.ru/sitemap.xml. - Выполнены проверки страниц под основным роботом.

- Организована загрузка URL в переобход под квоту.

- Подготовлен и заполнен пул важных страниц для мониторинга.

9) Деплой и артефакты

- Подготовлен технический чеклист выкладки.

- Подготовлены отчетные материалы (подробный и бизнес-контур).

- Сформированы файлы URL для переобхода и трекинга важных страниц.

10) Вывод для техлида

Критичный минимум закрыт: сайт приведен к рабочей и масштабируемой схеме индексации, home существенно ускорен,

legacy-ошибки переведены в управляемый режим, качество sitemap улучшено.

Дальнейшая отдача по SEO зависит от P1-этапа (оптимизация внутренних страниц + точечные redirect maps + контроль трендов в Вебмастере).

1) Техническое резюме

- Индексационный контур переведен в корректную модель:

индекс sitemap -> секционные sitemap. - Состав sitemap улучшен: фильтрация слабых рубрик, дедупликация URL, архивное ограничение по давности, динамические

priority/changefreq. - Ускорен home-рендер: снижены N+1 и включено кэширование.

- Старые (legacy) URL формата

/*.htmlпереведены в управляемый сценарий:301 -> canonicalили410. - Подтвержден прирост времени ответа home: ~

6793ms -> 1359ms.

2) Что реализовано (архитектурно и в коде)

| Блок | Что сделано | Эффект |

|---|---|---|

| Sitemap / Индексация | django.contrib.sitemaps, маршруты /sitemap.xml и /sitemap-<section>.xml, cache_page(30m), фильтрация и дедупликация URL. |

Меньше мусорных URL, выше полезный сигнал для поискового робота. |

| Политика URL / Slug | Нормализация slug, ограничение длины, контроль хвостов, снижение хаотичных числовых суффиксов. | Снижение дублей и рост консистентности URL-структуры. |

| Производительность home | Оптимизация home, сокращение N+1, only(...), очистка дублей в шаблонах, cache_page(10m). |

Существенное снижение TTFB и объема шумного HTML. |

| Обработка legacy URL | Маршрут /<slug>.html: если найден контент — 301, если нет — 410 Gone. |

Исторические URL перестали быть неуправляемым пулом 404. |

3) Подтвержденные результаты

- Скорость home: улучшение порядка ~5x (

~6793ms -> ~1359ms). - Состояние sitemap:

sitemap.xmlотдается с кодом200, секционные карты доступны. - Стабильность обхода: критичных

5XXв текущем срезе нет; основной хвост — исторические4XX. - Базовые метаданные: на home подтверждены

title/description/canonical/robots/OG/Twitter/JSON-LD.

4) Причины проблем до правок (RCA)

- Исторические 404: наследие старой URL-структуры

/*.html. - Высокая задержка home: неоптимальные выборки, шаблонные дубли, тяжелый HTML.

- Низкое качество сигнала в sitemap: слабые категории, архивный шум, неоднородные slug.

5) Приоритизация следующего этапа

| Приоритет | Статус | Действия |

|---|---|---|

| P0 | Выполнено / контроль | Динамический sitemap, фильтрация URL, кэш sitemap/home, обработчик legacy 301/410, контроль перекрытия статическим /sitemap.xml. |

| P1 | Следующий спринт | Оптимизировать show_category, show_post, search_results; точечные правила редиректов по самым частым legacy URL; зачистка устаревшей внутренней линковки. |

| P2 | Плановый этап | Еженедельный срез crawl budget, post-deploy smoke-проверки, расширенный structured data по типам шаблонов. |

6) Что сделано в Яндекс Вебмастере

- Подтвержден основной sitemap:

https://rp9.ru/sitemap.xml. - Выполнены проверки страниц под основным роботом.

- Организована загрузка URL в переобход под квоту.

- Подготовлен пул важных страниц для постоянного мониторинга статуса.

7) План контроля на 14 дней

| Период | Контрольные действия | Ожидаемый результат |

|---|---|---|

| День 1-3 | Переподать sitemap, отправить приоритетные URL в переобход, проверить home/category/post. | Стабильные 200, корректная обработка в вебмастерах. |

| День 4-7 | Проверить динамику 4XX/5XX, отследить статус “Страницы в поиске”. | Нет новых массовых ошибок, видна первичная стабилизация. |

| День 8-14 | Сверить тренд индексации и важных URL, собрать бэклог этапа 2. | Подтверждение эффекта и приоритизация следующей волны работ. |

8) KPI и пороговые ориентиры

- Скорость home (для робота): целевой диапазон

1.0–2.0s. - 5XX: целевой уровень ~0.

- 4XX: устойчивый нисходящий тренд по legacy-пулу.

- Sitemap: парсинг

OK, без ошибок обработки. - Индексация: без немотивированных просадок >20% на 2-недельном окне.

9) Финальный вывод для руководителя

Критичный минимум закрыт: сайт переведен в рабочую и масштабируемую схему индексации, home заметно ускорен,

legacy-ошибки переведены в управляемый режим, качество sitemap улучшено. Следующая отдача по SEO зависит от P1-этапа:

оптимизация внутренних страниц + точечные redirect maps + контроль трендов в Вебмастере.

10) Зафиксированные достигнутые результаты (факт)

- Скорость home: до ~6793ms, после ~1359ms (порядка ~5x).

- Индексационный контур: robots + sitemap index + секционные карты доступны и отдаются корректно.

- Критические ошибки: в текущих проверках 5XX отсутствуют/близки к нулю.

- Legacy URL: старые

/*.htmlпереведены в управляемый сценарий301/410.

11) Что сделано в Яндекс Вебмастере

- Подтвержден и используется основной sitemap:

https://rp9.ru/sitemap.xml. - Построена схема суточного переобхода по приоритетным URL и квотным пакетам.

- Подготовлен отдельный набор “важных страниц” для постоянного мониторинга статуса.

- Проверки выполнялись под Основным роботом Яндекса:

200 OK, корректные мета-сигналы, рабочая индексационная инфраструктура.

12) Срочный этап усиления (выполнено)

ARCHIVE_DAYS_CUTOFFужесточен:150 -> 90.NEWS_SITEMAP_MAX_URLSограничен:600 -> 500.- Добавлен фильтр обрезанных slug (служебные хвосты, подозрительно короткие последние токены, шаблонные обрывы).

- Сохранены фильтры слабых рубрик, дедупликация URL и отсечение “грязных” slug.

13) Нужно ли заново отправлять на переобход

Да, нужно. После ужесточения sitemap требуется повторная отправка приоритетного пула URL в Яндекс.Вебмастере

и контроль статусов через 7-14 дней.

14) Подготовленные списки URL для Яндекс Вебмастера

Список 0: YANDEX_RECRAWL_TOP20_2026-04-26 (первоочередной сигнал)

20 URL с наиболее сильным и свежим сигналом для первоочередной ручной отправки на переобход.

https://rp9.ru/novosti/chislo-pereustupok-po-ddu-v-moskve-vyroslo-vpervye-s-2020-goda https://rp9.ru/zastrojshiki/gk-razvitie-predstavit-premialnye-proekty-v-novom-formate https://rp9.ru/novosti/pochemu-klienty-vybiraiut-imenno-vas https://rp9.ru/novosti/pokupka-kvartiry-v-rossii-zanimaet-v-srednem-tri-goda-level-group https://rp9.ru/novosti/poslednii-shans-popast-na-urban-tur-po-kliuchevym-obektam-moskvy-i-forum-pro-gorod https://rp9.ru/zastrojshiki/vyruchka-zastroishchikov-v-moskve-upala-vo-vsekh-segmentakh-novostroek https://rp9.ru/novosti/eksperiment-ne-predpolagaet-spisaniia-zadolzhennosti-v-elektronnoi-forme https://rp9.ru/novosti/analitiki-otsenili-doplatu-za-uvelichenie-zhilploshchadi-v-krupneishikh-gorodakh-rossii https://rp9.ru/mnenie-ekspertov/rynok-novostroek-stolknulsia-s-pereizbytkom-predlozheniia https://rp9.ru/ipoteka/rynok-bazovykh-ipotechnykh-programm-vyrastet-bolee-chem-vdvoe-v-2026-godu https://rp9.ru/nedvizhimost/rieltory-stali-tshchatelnee-proveriat-prodavtsov-zhilia https://rp9.ru/nedvizhimost-moskvy/tseny-na-ofisnuiu-nedvizhimost-v-moskve-za-god-vyrosli-na-122-nf-group https://rp9.ru/novosti-nedvizhimosti/dolia-nerasprodannykh-kvartir-k-vvodu-doma-vyrosla-pochti-vdvoe-domklik https://rp9.ru/novosti/kabmin-podderzhal-otmenu-ogranichenii-na-prodazhu-zhilia-korruptsionerov https://rp9.ru/izhs/izhs-stanovitsia-prozrachnee-blagodaria-tsifrovizatsii https://rp9.ru/novosti/v-moskve-nakonets-rekonstruiruiut-shukhovskuiu-bashniu https://rp9.ru/zhkh/chto-izmenitsia-dlia-zhkkh-i-grazhdan-s-aprelia-2026-goda https://rp9.ru/mnenie-ekspertov/initsiativa-rasshirit-lgotnuiu-semeinuiu-ipoteku-na-vtorichnyi-rynok-mozhet-zametno-izmenit-balans-sprosa https://rp9.ru/novosti/dom-rf-predlagaet-rasprostranit-eskrou-na-vse-izhs-s-ispolzovaniem-ipoteki https://rp9.ru/mnenie-ekspertov/portret-pokupatelia-v-2026-godu

Список 1: YANDEX_IMPORTANT_PAGES_100_2026-04-26 (приоритетный)

https://rp9.ru/ https://rp9.ru/novosti https://rp9.ru/zastrojshiki https://rp9.ru/nedvizhimost https://rp9.ru/ipoteka https://rp9.ru/zhkh https://rp9.ru/izhs https://rp9.ru/nedvizhimost-moskvy https://rp9.ru/mnenie-ekspertov https://rp9.ru/novosti-nedvizhimosti https://rp9.ru/stroitelstvo https://rp9.ru/strojmaterialy https://rp9.ru/novosti/chislo-pereustupok-po-ddu-v-moskve-vyroslo-vpervye-s-2020-goda https://rp9.ru/zastrojshiki/gk-razvitie-predstavit-premialnye-proekty-v-novom-formate https://rp9.ru/novosti/pochemu-klienty-vybiraiut-imenno-vas https://rp9.ru/novosti/pokupka-kvartiry-v-rossii-zanimaet-v-srednem-tri-goda-level-group https://rp9.ru/novosti/investitsii-v-zemliu-pod-development-snizilis-na-tret https://rp9.ru/novosti/poslednii-shans-popast-na-urban-tur-po-kliuchevym-obektam-moskvy-i-forum-pro-gorod https://rp9.ru/zastrojshiki/vyruchka-zastroishchikov-v-moskve-upala-vo-vsekh-segmentakh-novostroek https://rp9.ru/novosti/eksperiment-ne-predpolagaet-spisaniia-zadolzhennosti-v-elektronnoi-forme https://rp9.ru/zastrojshiki/developer-sreda-vykhodit-v-kommercheskuiu-nedvizhimost-moskvy https://rp9.ru/novosti/analitiki-otsenili-doplatu-za-uvelichenie-zhilploshchadi-v-krupneishikh-gorodakh-rossii https://rp9.ru/zastrojshiki/zastroishchiki-massovo-aktivizirovali-programmy-rassrochki-posle-padeniia-sprosa https://rp9.ru/novosti/zhiteli-kurska-smogut-poluchat-sertifikaty-za-utrachennoe-imushchestvo https://rp9.ru/novosti/munitsipalnyi-zemelnyi-kontrol-mozhet-stat-instrumentom-povysheniia-kapitalizatsii-territorii-rosreestr https://rp9.ru/novosti/rossiiane-stali-chashche-arendovat-sklady-dlia-lichnykh-veshchei https://rp9.ru/novosti/u-vsekh-mkd-dolzhen-byt-svoi-elektronnyi-pasport https://rp9.ru/mnenie-ekspertov/rynok-novostroek-stolknulsia-s-pereizbytkom-predlozheniia https://rp9.ru/novosti/realnye-tseny-na-novostroiki-v-i-kvartale-snizilis-dom-rf https://rp9.ru/zhkh/genprokuratura-vyiavila-428-tys-sluchaev-narushenii-v-zhkkh https://rp9.ru/novosti/ofisy-klassa-a-perestanut-byt-defitsitom https://rp9.ru/novosti/defitsit-biudzheta-rf-v-pervom-kvartale-ne-vyzyvaet-opasenii-minfin https://rp9.ru/novosti/ekonomika-rf-vpervye-stolknulas-s-nekhvatkoi-rabochei-sily https://rp9.ru/izhs/regiony-okazhut-neobkhodimuiu-pomoshch-postradavshim-dolshchikam-izhs https://rp9.ru/novosti/v-gosdume-predlozhili-prodlit-garantiiu-na-novostroiki https://rp9.ru/novosti/banki-prodolzhaiut-zakryvat-svoi-otdeleniia-po-vsei-rossii https://rp9.ru/novosti/premium-segment-zhilia-stal-draiverom-rynka-novostroek-v-moskve https://rp9.ru/novosti/miniust-khochet-razreshit-prodazhu-roskoshnogo-zhilia-bankrotov https://rp9.ru/novosti/v-belorussii-prodaiut-chastnye-doma-za-bestsenok https://rp9.ru/novosti/poteri-v-stroitelnykh-proektakh-ot-etapa-investitsionnogo-resheniia-do-sdachi-obekta-dostigaiut-desiatkov-protsentov https://rp9.ru/novosti/gosduma-predlagaet-prodlit-srok-registratsii-nedvizhimosti-v-donbasse-i-novorossii https://rp9.ru/mnenie-ekspertov/arenda-moskovskikh-ofisov-prodolzhaet-rasti https://rp9.ru/novosti/operatorov-i-banki-mogut-obiazat-vozvrashchat-ukradennye-moshennikami-dengi https://rp9.ru/nedvizhimost/rieltory-stali-tshchatelnee-proveriat-prodavtsov-zhilia https://rp9.ru/mnenie-ekspertov/zhilye-developery-formiruiut-okolo-70-pervichnogo-rynka-ofisov-moskvy https://rp9.ru/novosti/v-gosdume-predlozhili-uzhestochit-kontrol-za-kapremontom https://rp9.ru/novosti/regiony-sokratili-zakupki-liftov-po-programmam-kapremonta https://rp9.ru/novosti-nedvizhimosti/dolia-nerasprodannykh-kvartir-k-vvodu-doma-vyrosla-pochti-vdvoe-domklik https://rp9.ru/novosti/t-investitsii-zapustili-zakrytyi-fond-industrialnoi-nedvizhimosti https://rp9.ru/zastrojshiki/krost-poluchil-razreshenie-na-vvod-v-ekspluatatsiiu-svoego-zolotogo-doma-malevich https://rp9.ru/ipoteka/rynok-bazovykh-ipotechnykh-programm-vyrastet-bolee-chem-vdvoe-v-2026-godu https://rp9.ru/novosti/rosreestr-budet-poluchat-kartograficheskie-dannye-iz-kosmosa https://rp9.ru/novosti/investitsii-v-nedvizhimost-upadut-pochti-vdvoe-v-2026-godu https://rp9.ru/novosti/minstroi-vydelil-belgorodskoi-oblasti-bolee-30-mlrd-s-2023-goda https://rp9.ru/novosti/matkapital-khotiat-vyplachivat-tolko-posle-piati-let-grazhdanstva https://rp9.ru/novosti/alla-pugacheva-taino-prodaet-svoiu-kvartiru-na-arbate-tass https://rp9.ru/zastrojshiki/iz-chego-sostoit-novaia-klassika-kollektsionnaia-nedvizhimost-v-raione-nikol-ot-mr-private https://rp9.ru/nedvizhimost-moskvy/tseny-na-ofisnuiu-nedvizhimost-v-moskve-za-god-vyrosli-na-122-nf-group https://rp9.ru/zastrojshiki/v-moskve-na-stroike-zhk-rabotaet-bashennyi-kran-s-distantsionnym-upravleniem https://rp9.ru/novosti-nedvizhimosti/na-rynke-novostroek-kopiatsia-gotovye-kvartiry https://rp9.ru/novosti/kabmin-podderzhal-otmenu-ogranichenii-na-prodazhu-zhilia-korruptsionerov https://rp9.ru/novosti/sotsfond-nachnet-priem-zaiavok-na-semeinye-vyplaty-s-1-iiunia https://rp9.ru/ipoteka/22-regiona-prosiat-v-dva-raza-povysit-limity-po-semeinoi-ipoteke https://rp9.ru/izhs/izhs-stanovitsia-prozrachnee-blagodaria-tsifrovizatsii https://rp9.ru/novosti/zakreditovannost-naseleniia-stanovitsia-glavnym-ogranicheniem-sprosa-na-zhile-eksperty https://rp9.ru/novosti/rossiiskii-rynok-stali-voshel-v-vesnu-bez-rosta https://rp9.ru/novosti-nedvizhimosti/obem-prodazh-nedvizhimosti-v-abu-dabi-vyros-bolee-chem-na-138-mlrd https://rp9.ru/novosti/v-moskve-nakonets-rekonstruiruiut-shukhovskuiu-bashniu https://rp9.ru/novosti/schetnaia-palata-predlagaet-minstroiu-alternativnyi-mekhanizm-rasseleniia-avariinogo-zhilia https://rp9.ru/novosti/vtb-stal-vladeltsem-elitnykh-apartamentov-v-otele-four-seasons-hotel-moscow https://rp9.ru/novosti/dolgi-za-kapremont-khotiat-otviazat-ot-kvartiry https://rp9.ru/zhkh/chto-izmenitsia-dlia-zhkkh-i-grazhdan-s-aprelia-2026-goda https://rp9.ru/novosti/s-31-marta-v-podmoskove-startuet-novyi-etap-programmy-zhilishchnykh-sertifikatov-dlia-pereseleniia-iz-avariinogo-zhilia https://rp9.ru/novosti/gosdolg-rossii-vyros-na-6-trln-za-god-schetnaia-palata https://rp9.ru/novosti/moratorii-na-neustoiki-po-shtrafam-dlia-zastroishchikov-dorogo-oboidetsia-dolshchikam https://rp9.ru/novosti/kabmin-napravit-1-mlrd-na-gazifikatsiiu-domov-lgotnikov-v-2026-godu https://rp9.ru/novosti/magaziny-odezhdy-proigryvaiut-marketpleisam https://rp9.ru/mnenie-ekspertov/otkaz-ot-migrantov-ne-reshit-kliuchevuiu-problemu-stroitelstva https://rp9.ru/mnenie-ekspertov/initsiativa-rasshirit-lgotnuiu-semeinuiu-ipoteku-na-vtorichnyi-rynok-mozhet-zametno-izmenit-balans-sprosa https://rp9.ru/nedvizhimost/predlozhenie-na-rynke-dolgosrochnoi-arendy-vyroslo-do-maksimuma-za-3-goda https://rp9.ru/novosti/kitai-zainteresovan-v-roste-reputatsii-stroimaterialov-nostroi https://rp9.ru/novosti/minstroi-zapustil-v-max-servisy-operativnoi-pomoshchi-zhiltsam-v-mkd https://rp9.ru/novosti/rossiiane-nachali-razvoditsia-radi-semeinoi-ipoteki https://rp9.ru/novosti/dom-rf-predlagaet-rasprostranit-eskrou-na-vse-izhs-s-ispolzovaniem-ipoteki https://rp9.ru/nedvizhimost-moskvy/sredniaia-tsena-m2-v-moskva-siti-prevysila-1-mln-metrium https://rp9.ru/novosti/bespilotniki-pomogut-zashchitit-zemelnye-uchastki-ot-musora-i-pozharov-rosreestr-moskvy https://rp9.ru/mnenie-ekspertov/kak-zhiltsam-ne-platit-za-fiktivnykh-dvornikov https://rp9.ru/ipoteka/lgotnaia-ipoteka-prosela-na-62-za-mesiats https://rp9.ru/zastrojshiki/v-2025-godu-donstroi-vvel-bolee-1-mln-m2 https://rp9.ru/zhkh/fas-smozhet-napriamuiu-snizhat-tarify-zhkkh https://rp9.ru/nedvizhimost/broshennye-mashiny-vo-dvore-otpugivaet-liudei-ot-pokupki-kvartiry https://rp9.ru/novosti/v-gosdume-obsuzhdaiut-ogranicheniia-na-zalog-zhilia-po-zaimam-ot-fizlits https://rp9.ru/stroitelstvo/stroitelstvo-chastnykh-domov-za-god-podorozhalo-pochti-na-chetvert https://rp9.ru/nedvizhimost/t-bank-i-podvodnye-kamni-dlia-sdelok-s-nedvizhimostiu https://rp9.ru/zhkh/zakonoproekt-ob-elektronnykh-platezhakh-zhkkh-uzhe-gotov https://rp9.ru/novosti/regiony-predlagaiut-vvesti-dopolnitelnyi-nalog-dlia-vladeltsev-trekh-i-bolee-kvartir https://rp9.ru/novosti/pravitelstvo-odobrilo-zakonoproekt-kotoryi-ogranichivaet-srok-iskovoi-davnosti-po-delam-o-privatizatsii-10-godami https://rp9.ru/novosti/chislo-magazinov-stroimaterialov-v-rossii-upalo-na-11-za-chetyre-goda https://rp9.ru/novosti-nedvizhimosti/v-peterburge-stali-menshe-stroit https://rp9.ru/novosti/v-dagestane-zapustili-testirovanie-ofitsialnoi-akkreditatsii-rieltorov

Список 2: YANDEX_RECRAWL_PRIORITY_2026-04-26 (расширенный)

Расширенный список включает базовый приоритетный набор + дополнительные рубрики:

/analitika, /arhitektura, /biznes, /finansy, /interer и расширенный пул статей для квотного переобхода.https://rp9.ru/ https://rp9.ru/novosti https://rp9.ru/zastrojshiki https://rp9.ru/nedvizhimost https://rp9.ru/ipoteka https://rp9.ru/zhkh https://rp9.ru/izhs https://rp9.ru/nedvizhimost-moskvy https://rp9.ru/mnenie-ekspertov https://rp9.ru/novosti-nedvizhimosti https://rp9.ru/stroitelstvo https://rp9.ru/strojmaterialy https://rp9.ru/analitika https://rp9.ru/arhitektura https://rp9.ru/biznes https://rp9.ru/finansy https://rp9.ru/interer https://rp9.ru/novosti/chislo-pereustupok-po-ddu-v-moskve-vyroslo-vpervye-s-2020-goda https://rp9.ru/zastrojshiki/gk-razvitie-predstavit-premialnye-proekty-v-novom-formate https://rp9.ru/novosti/pochemu-klienty-vybiraiut-imenno-vas https://rp9.ru/novosti/pokupka-kvartiry-v-rossii-zanimaet-v-srednem-tri-goda-level-group https://rp9.ru/novosti/investitsii-v-zemliu-pod-development-snizilis-na-tret https://rp9.ru/novosti/poslednii-shans-popast-na-urban-tur-po-kliuchevym-obektam-moskvy-i-forum-pro-gorod https://rp9.ru/zastrojshiki/vyruchka-zastroishchikov-v-moskve-upala-vo-vsekh-segmentakh-novostroek https://rp9.ru/novosti/eksperiment-ne-predpolagaet-spisaniia-zadolzhennosti-v-elektronnoi-forme https://rp9.ru/zastrojshiki/developer-sreda-vykhodit-v-kommercheskuiu-nedvizhimost-moskvy https://rp9.ru/novosti/analitiki-otsenili-doplatu-za-uvelichenie-zhilploshchadi-v-krupneishikh-gorodakh-rossii https://rp9.ru/zastrojshiki/zastroishchiki-massovo-aktivizirovali-programmy-rassrochki-posle-padeniia-sprosa https://rp9.ru/novosti/zhiteli-kurska-smogut-poluchat-sertifikaty-za-utrachennoe-imushchestvo https://rp9.ru/novosti/munitsipalnyi-zemelnyi-kontrol-mozhet-stat-instrumentom-povysheniia-kapitalizatsii-territorii-rosreestr https://rp9.ru/novosti/rossiiane-stali-chashche-arendovat-sklady-dlia-lichnykh-veshchei https://rp9.ru/novosti/u-vsekh-mkd-dolzhen-byt-svoi-elektronnyi-pasport https://rp9.ru/mnenie-ekspertov/rynok-novostroek-stolknulsia-s-pereizbytkom-predlozheniia https://rp9.ru/novosti/realnye-tseny-na-novostroiki-v-i-kvartale-snizilis-dom-rf https://rp9.ru/zhkh/genprokuratura-vyiavila-428-tys-sluchaev-narushenii-v-zhkkh https://rp9.ru/novosti/ofisy-klassa-a-perestanut-byt-defitsitom https://rp9.ru/novosti/defitsit-biudzheta-rf-v-pervom-kvartale-ne-vyzyvaet-opasenii-minfin https://rp9.ru/novosti/ekonomika-rf-vpervye-stolknulas-s-nekhvatkoi-rabochei-sily https://rp9.ru/izhs/regiony-okazhut-neobkhodimuiu-pomoshch-postradavshim-dolshchikam-izhs https://rp9.ru/novosti/v-gosdume-predlozhili-prodlit-garantiiu-na-novostroiki https://rp9.ru/novosti/banki-prodolzhaiut-zakryvat-svoi-otdeleniia-po-vsei-rossii https://rp9.ru/novosti/premium-segment-zhilia-stal-draiverom-rynka-novostroek-v-moskve https://rp9.ru/novosti/miniust-khochet-razreshit-prodazhu-roskoshnogo-zhilia-bankrotov https://rp9.ru/novosti/v-belorussii-prodaiut-chastnye-doma-za-bestsenok https://rp9.ru/novosti/poteri-v-stroitelnykh-proektakh-ot-etapa-investitsionnogo-resheniia-do-sdachi-obekta-dostigaiut-desiatkov-protsentov https://rp9.ru/novosti/gosduma-predlagaet-prodlit-srok-registratsii-nedvizhimosti-v-donbasse-i-novorossii https://rp9.ru/mnenie-ekspertov/arenda-moskovskikh-ofisov-prodolzhaet-rasti https://rp9.ru/novosti/operatorov-i-banki-mogut-obiazat-vozvrashchat-ukradennye-moshennikami-dengi https://rp9.ru/nedvizhimost/rieltory-stali-tshchatelnee-proveriat-prodavtsov-zhilia https://rp9.ru/mnenie-ekspertov/zhilye-developery-formiruiut-okolo-70-pervichnogo-rynka-ofisov-moskvy https://rp9.ru/novosti/v-gosdume-predlozhili-uzhestochit-kontrol-za-kapremontom https://rp9.ru/novosti/regiony-sokratili-zakupki-liftov-po-programmam-kapremonta https://rp9.ru/novosti-nedvizhimosti/dolia-nerasprodannykh-kvartir-k-vvodu-doma-vyrosla-pochti-vdvoe-domklik https://rp9.ru/novosti/t-investitsii-zapustili-zakrytyi-fond-industrialnoi-nedvizhimosti https://rp9.ru/zastrojshiki/krost-poluchil-razreshenie-na-vvod-v-ekspluatatsiiu-svoego-zolotogo-doma-malevich https://rp9.ru/ipoteka/rynok-bazovykh-ipotechnykh-programm-vyrastet-bolee-chem-vdvoe-v-2026-godu https://rp9.ru/novosti/rosreestr-budet-poluchat-kartograficheskie-dannye-iz-kosmosa https://rp9.ru/novosti/investitsii-v-nedvizhimost-upadut-pochti-vdvoe-v-2026-godu https://rp9.ru/novosti/minstroi-vydelil-belgorodskoi-oblasti-bolee-30-mlrd-s-2023-goda https://rp9.ru/novosti/matkapital-khotiat-vyplachivat-tolko-posle-piati-let-grazhdanstva https://rp9.ru/novosti/alla-pugacheva-taino-prodaet-svoiu-kvartiru-na-arbate-tass https://rp9.ru/zastrojshiki/iz-chego-sostoit-novaia-klassika-kollektsionnaia-nedvizhimost-v-raione-nikol-ot-mr-private https://rp9.ru/nedvizhimost-moskvy/tseny-na-ofisnuiu-nedvizhimost-v-moskve-za-god-vyrosli-na-122-nf-group https://rp9.ru/zastrojshiki/v-moskve-na-stroike-zhk-rabotaet-bashennyi-kran-s-distantsionnym-upravleniem https://rp9.ru/novosti-nedvizhimosti/na-rynke-novostroek-kopiatsia-gotovye-kvartiry https://rp9.ru/novosti/kabmin-podderzhal-otmenu-ogranichenii-na-prodazhu-zhilia-korruptsionerov https://rp9.ru/novosti/sotsfond-nachnet-priem-zaiavok-na-semeinye-vyplaty-s-1-iiunia https://rp9.ru/ipoteka/22-regiona-prosiat-v-dva-raza-povysit-limity-po-semeinoi-ipoteke https://rp9.ru/izhs/izhs-stanovitsia-prozrachnee-blagodaria-tsifrovizatsii https://rp9.ru/novosti/zakreditovannost-naseleniia-stanovitsia-glavnym-ogranicheniem-sprosa-na-zhile-eksperty https://rp9.ru/novosti/rossiiskii-rynok-stali-voshel-v-vesnu-bez-rosta https://rp9.ru/novosti-nedvizhimosti/obem-prodazh-nedvizhimosti-v-abu-dabi-vyros-bolee-chem-na-138-mlrd https://rp9.ru/novosti/v-moskve-nakonets-rekonstruiruiut-shukhovskuiu-bashniu https://rp9.ru/novosti/schetnaia-palata-predlagaet-minstroiu-alternativnyi-mekhanizm-rasseleniia-avariinogo-zhilia https://rp9.ru/novosti/vtb-stal-vladeltsem-elitnykh-apartamentov-v-otele-four-seasons-hotel-moscow https://rp9.ru/novosti/dolgi-za-kapremont-khotiat-otviazat-ot-kvartiry https://rp9.ru/zhkh/chto-izmenitsia-dlia-zhkkh-i-grazhdan-s-aprelia-2026-goda https://rp9.ru/novosti/s-31-marta-v-podmoskove-startuet-novyi-etap-programmy-zhilishchnykh-sertifikatov-dlia-pereseleniia-iz-avariinogo-zhilia https://rp9.ru/novosti/gosdolg-rossii-vyros-na-6-trln-za-god-schetnaia-palata https://rp9.ru/novosti/moratorii-na-neustoiki-po-shtrafam-dlia-zastroishchikov-dorogo-oboidetsia-dolshchikam https://rp9.ru/novosti/kabmin-napravit-1-mlrd-na-gazifikatsiiu-domov-lgotnikov-v-2026-godu https://rp9.ru/novosti/magaziny-odezhdy-proigryvaiut-marketpleisam https://rp9.ru/mnenie-ekspertov/otkaz-ot-migrantov-ne-reshit-kliuchevuiu-problemu-stroitelstva https://rp9.ru/mnenie-ekspertov/initsiativa-rasshirit-lgotnuiu-semeinuiu-ipoteku-na-vtorichnyi-rynok-mozhet-zametno-izmenit-balans-sprosa https://rp9.ru/nedvizhimost/predlozhenie-na-rynke-dolgosrochnoi-arendy-vyroslo-do-maksimuma-za-3-goda https://rp9.ru/novosti/kitai-zainteresovan-v-roste-reputatsii-stroimaterialov-nostroi https://rp9.ru/novosti/minstroi-zapustil-v-max-servisy-operativnoi-pomoshchi-zhiltsam-v-mkd https://rp9.ru/novosti/rossiiane-nachali-razvoditsia-radi-semeinoi-ipoteki https://rp9.ru/novosti/dom-rf-predlagaet-rasprostranit-eskrou-na-vse-izhs-s-ispolzovaniem-ipoteki https://rp9.ru/nedvizhimost-moskvy/sredniaia-tsena-m2-v-moskva-siti-prevysila-1-mln-metrium https://rp9.ru/novosti/bespilotniki-pomogut-zashchitit-zemelnye-uchastki-ot-musora-i-pozharov-rosreestr-moskvy https://rp9.ru/mnenie-ekspertov/kak-zhiltsam-ne-platit-za-fiktivnykh-dvornikov https://rp9.ru/ipoteka/lgotnaia-ipoteka-prosela-na-62-za-mesiats https://rp9.ru/zastrojshiki/v-2025-godu-donstroi-vvel-bolee-1-mln-m2 https://rp9.ru/zhkh/fas-smozhet-napriamuiu-snizhat-tarify-zhkkh https://rp9.ru/nedvizhimost/broshennye-mashiny-vo-dvore-otpugivaet-liudei-ot-pokupki-kvartiry https://rp9.ru/novosti/v-gosdume-obsuzhdaiut-ogranicheniia-na-zalog-zhilia-po-zaimam-ot-fizlits https://rp9.ru/stroitelstvo/stroitelstvo-chastnykh-domov-za-god-podorozhalo-pochti-na-chetvert https://rp9.ru/nedvizhimost/t-bank-i-podvodnye-kamni-dlia-sdelok-s-nedvizhimostiu https://rp9.ru/zhkh/zakonoproekt-ob-elektronnykh-platezhakh-zhkkh-uzhe-gotov https://rp9.ru/novosti/regiony-predlagaiut-vvesti-dopolnitelnyi-nalog-dlia-vladeltsev-trekh-i-bolee-kvartir https://rp9.ru/zastrojshiki/sezar-group-zapuskaet-otdelnoe-napravlenie-kommercheskoi-nedvizhimosti-sezar-pro https://rp9.ru/novosti/v-zhk-sadovnicheskaia-69-ves-2025-god-stroili-pod-zemlei https://rp9.ru/novosti/minstroi-khochet-perevesti-podachu-zaiavlenii-pri-chs-na-gosuslugi https://rp9.ru/novosti/bolee-1-tys-krupnykh-obektov-vvedut-po-gosprogramme-stroitelstvo https://rp9.ru/novosti/gosduma-zapretila-ustanavlivat-ispytatelnyi-srok-zhenshchinam-s-detmi-do-trekh-let https://rp9.ru/novosti/novostroiki-v-krupnykh-gorodakh-podorozhali-v-21-raza-za-piat-let https://rp9.ru/novosti/v-omskoi-oblasti-vpervye-iziali-zabroshennye-uchastki-po-novomu-zakonu https://rp9.ru/mnenie-ekspertov/pochemu-klienty-vybiraiut-imenno-vas-spetsproekt-beloi-kaski https://rp9.ru/novosti/pravitelstvo-odobrilo-zakonoproekt-kotoryi-ogranichivaet-srok-iskovoi-davnosti-po-delam-o-privatizatsii-10-godami https://rp9.ru/novosti/chislo-magazinov-stroimaterialov-v-rossii-upalo-na-11-za-chetyre-goda https://rp9.ru/novosti-nedvizhimosti/v-peterburge-stali-menshe-stroit https://rp9.ru/novosti/v-dagestane-zapustili-testirovanie-ofitsialnoi-akkreditatsii-rieltorov

15) Единый порядок ручной отправки в Яндекс Вебмастер (обязательно)

- Шаг 1: отправить

YANDEX_RECRAWL_TOP20_2026-04-26.txt(самый сильный и свежий сигнал). - Шаг 2: отправить

YANDEX_IMPORTANT_PAGES_100_2026-04-26.txt(мониторинговый пул). - Шаг 3: отправить

YANDEX_RECRAWL_PRIORITY_2026-04-26.txt(расширенный квотный переобход).

Этот порядок обязателен для всех запусков команды, чтобы не расходовать квоту на менее приоритетные URL раньше времени.

16) Деплой: полный список изменений (26.04.2026)

Выполнять строго по файлу:

/site_unpack/from_zip/rp9.ru/DEPLOY_ALL_CHANGES_2026-04-26.md.

- Залить измененные файлы из

White_Helmet/main/...иrobots.txt. - Проверить, что статический

/sitemap.xmlне перекрывает Django sitemap route. - Перезапустить Passenger через

/tmp/restart.txt. - Проверить после рестарта:

home,/sitemap.xml,/sitemap-news.xml,/sitemap-categories.xml. - Проверить, что в

sitemap-news.xmlнет мусорных slug и что хвост не старше окна90дней.

17) Обязательные шаблоны для выкладки (SEO-микропатч)

White_Helmet/main/templates/main/layout.htmlWhite_Helmet/main/templates/main/home.htmlWhite_Helmet/main/templates/main/category.htmlWhite_Helmet/main/templates/main/post.html

После деплоя проверить в исходном коде страниц:

og:image:width, og:image:height, twitter:image:alt, JSON-LD SearchAction, BreadcrumbList (на внутренних URL).18) Финальные технические фиксации в коде

- Sitemap quality: cutoff

ARCHIVE_DAYS_CUTOFF = 90, лимитNEWS_SITEMAP_MAX_URLS = 500, фильтры truncated/garbage slug. - Whitelist-рекатегоризация: сильные URL из

bez-rubriki/raznoeточечно переводятся в профильные рубрики черезWHITELIST_RECATEGORY_MAP. - Metadata hardening: добавлены

og:image:width/height,twitter:image:alt,WebSite + SearchAction,BreadcrumbList. - Legacy URL: маршрут

/*.htmlобрабатывается как301на canonical либо410.

19) Финальный контроль после выкладки

- Проверить код ответа и скорость home для основного робота Яндекса.

- Сравнить 7-14-дневный тренд

4XX/5XX(без оценки по единичным историческим датам). - Проверить статус индексации по списку TOP20 и списку 100 важных страниц.

- Зафиксировать в отчете срез: “Страницы в поиске”, “Исключенные”, “Переобход”.

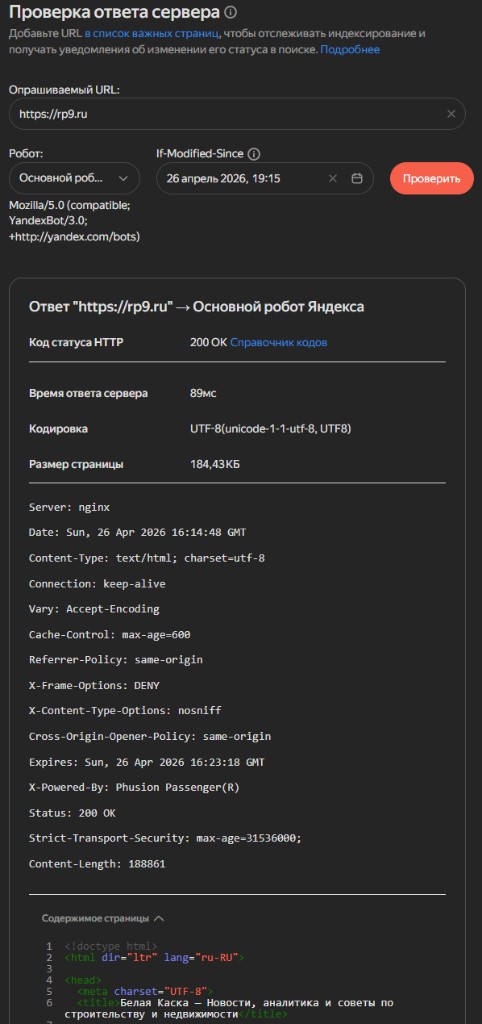

20) Результаты проверки главной (факт) и следующие действия

- Текущее состояние:

200 OK, время ответа ~89ms, кодировкаUTF-8, базовые заголовки безопасности и кэш присутствуют. - Подтверждено внедрение SEO-слоя:

og:image:width,og:image:height,twitter:image:alt, JSON-LDWebSite,SearchAction,Organization. - Критичный следующий шаг: дочистить обрезанные slug в контентных витринах (например, URL вида

...-vyros-na), чтобы слабые URL не попадали в главную/рубрики. - Правило публикации: слабые и обрезанные slug — либо исправлять в БД/админке, либо исключать из home/category выборок (и оставлять исключенными из sitemap).